[슬로우리포트] “좌파 AI” 트럼프 비난에 클로드 국방부 독점 공급 중단, 그 자리에 뛰어든 오픈AI… 생각의 속도보다 빠른 폭격의 시대, 자율 살상 무기의 통제 권한을 둘러싼 논란. (⌚6분)

전쟁에 AI가 활용된다는 건 비밀도 아니다.

지난 주말 도널드 트럼프(미국 대통령)가 이란에 미사일을 퍼붓기 몇 시간 전, 피트 헤그세스(미국 국방부 장관)와 다리오 아모데이(앤트로픽 CEO)는 오랜 논쟁을 끝내기로 했다.

미국 국방부가 앤트로픽과 독점 계약을 깼고 앤트로픽을 공급망 위험 요소(Supply Chain Security )로 지정했다. 모든 미국 정부에서 클로드를 쓰지 않겠다는 통보다.

이게 왜 중요한가.

- AI는 ‘알고 있는 알 수 없는 것(known unknown)’에서 ‘알 수 없는 알 수 없는 것(unknown unknown)’의 단계로 들어가고 있다. 이미 분석과 계산에서 인간의 능력을 넘어섰고 갈수록 알 수 없는 영역에 의존도가 높아지고 있다.

- 트럼프와 앤트로픽의 갈등은 AI의 통제 권한을 둘러싼 새로운 논쟁이 시작됐다는 의미다.

- 대충 알아서 잘 막아 달라는 명령은 대충 알아서 잘 죽여달라는 명령으로 이어질 수 있다. AI에 무기를 쥐어주면서 그 무기가 언젠가 우리를 공격하게 되지 않으리라는 믿음은 위험천만하다.

사건의 배경: 미국 국방부가 엔트로픽에 요구한 것과 거절한 것.

- “법이 허용하는 거의 모든 목적으로 AI을 사용할 수 있게 해달라고 했다”고 한다.

- 다리오 아모데이(앤트로픽 CEO)의 생각은 달랐다. 법이 AI의 속도를 따라가지 못하고 있을 뿐, 합법적이라고 옳은 건 아니라는 이야기다.

- “AI 기반 대규모 감시는 우리의 근본적인 자유에 심각하고 새로운 위험을 초래한다”고 경고했다.

- 두 가지 이유에서다. 첫째, 개인정보 보호가 부족하고 둘째, 이런 데이터를 어떻게 활용할 것인지 제한도 없다.

- 지금도 영장 없이 이동 경로와 웹 검색 기록, 사회적 관계 등의 데이터를 구입할 수 있다. 개별적으로는 무해한 데이터를 모아 어떤 사람의 삶에 대한 포괄적인 그림을 만들어낼 수도 있다.

- 법적 권한을 넘어서는 감시는 오랫동안 우려의 대상이었지만, 인공지능의 등장으로 그 문제가 더욱 심각해졌다.

- 미국 국방부는 지난 1월 니콜라스 마두로(베네수엘라 대통령)를 납치할 때도 팔란티어와 클로드를 이용했다.

- 미국 국방부는 앤트로픽과 독점 계약을 하면서 중국과 거래하지 않는 조건을 걸었고 앤트로픽은 손실을 감수하고 따랐다.

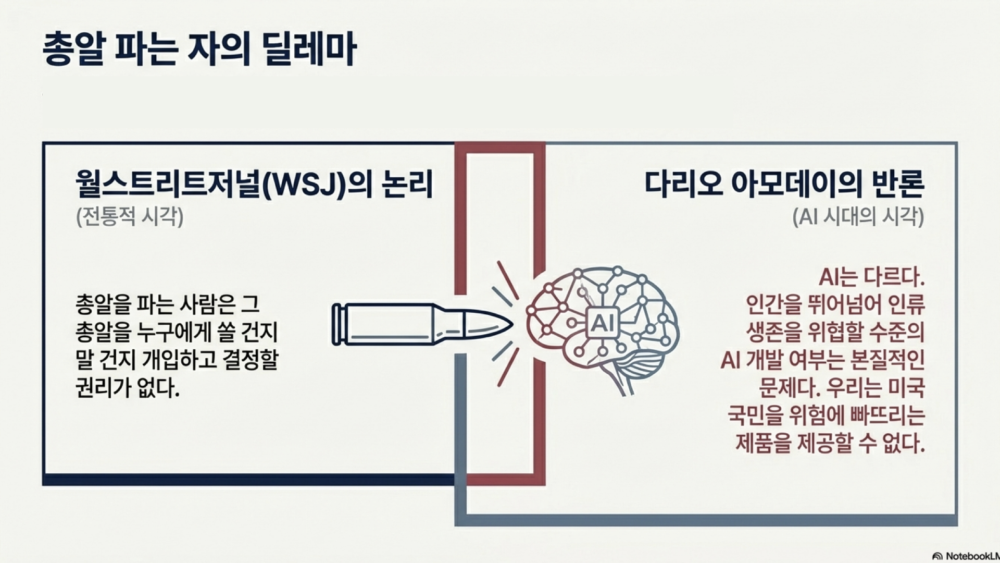

총알을 팔면서 누구를 쏠지 말지 개입할 수 있나.

- 월스트리트저널이 이런 논리를 폈다. 총알을 파는 사람은 그 총알을 누구에게 쏠 건지 말 건지 결정할 권리가 없다.

- 그런데 AI는 다를 수 있다. 인간을 뛰어넘어 인류의 생존을 위협할 수준의 AI를 개발할거냐 말거냐는 좀 더 본질적인 문제로 이어진다. 다리오 아모데이는 “미국 국민을 위험에 빠뜨리는 제품을 제공할 수는 없다”고 선을 그었다.

- 국방부는 “그들은 규칙을 만들 수 없다”는 입장이다. 규칙은 의회가 만들고 정부가 집행하면 된다는 이야기다.

- 애틀랜틱에 따르면 미국 국방부는 대량 국내 감시나 자율 살상 무기에 AI를 쓰지 않겠다”고 약속하면서도, 적절한 경우(as appropriate)라는 문구를 넣어 언제든 약속을 뒤집을 수 있는 여지를 남기려 했다. 아모데이는 “도를 넘은 요구(A bridge too far)”라고 판단했다.

- 에밀 마이클(국방부 차관보)는 블룸버그와 인터뷰에서 “드론 군집이든 미사일이든 사람이 대응하는 것보다 더 빠르게 격추할 수 있어야 한다”고 말했다.

- 뭔지 모르겠지만 알아서 막아주고 알아서 공격해 달라는 상황이다. 앤트로픽은 지금의 AI는 그렇게 믿고 맡길 정도는 아니라는 입장이고 국방부는 할 수 있으면 한다는 입장이다. 자율 무기 시스템이 이미 전쟁에 투입되고 있는 상황이다.

- 앤트로픽도 자율 무기를 거부하겠다는 게 아니라 아직은 자율 무기 시스템에 투입할 정도로 완전하지 않다는 입장이다.

두 가지 다른 질문.

- 이런 질문이 된다. 빠르고 자신감은 넘치지만 중대한 결정을 내리기에는 아직 부실한 AI를 믿을 수 있나.

- 질문을 이렇게 바꿔볼 수도 있다. 드론 군집을 효과적으로 격추할 수 있는 자율 무기가 있는데 민간 항공기를 공격할 가능성이 100만 분의 1이라도 있다면 중단해야 하나.

- 피트 헤그세스는 다리오 아모데이 같은 업자들이 결정할 문제가 아니라는 입장이다.

트럼프의 보복.

- 트럼프가 특유의 대문자를 섞어 쓴 글로 “앤트로픽의 좌파 광신도가 국방부를 강압적으로 압박하고 헌법 대신 자신들의 서비스 약관을 따르도록 강요하려 한 것은 재앙적인 실수였다(The Leftwing nut jobs at Anthropic have made a DISASTROUS MISTAKE trying to STRONG-ARM the Department of War, and force them to obey their Terms of Service instead of our Constitution)”고 비난했다.

- 악시오스에 따르면 난처한 건 미국 정부다. 거의 모든 부처가 클로드를 쓰고 있는데 갑자기 못 쓰게 됐다. NASA는 화성 탐사 비행에도 클로드의 도움을 받고 있다.

- 트럼프가 제시한 단계적 폐기 기한은 6개월이다. 당장 클로드를 전면 중단할 수 없을 정도로 클로드에 의존도가 높다는 이야기다. 6개월 안에 클로드가 아닌 다른 서비스로 갈아탈 수 있을지도 확실하지 않다.

클로드 빠진 자리에 챗GPT가 들어간다.

- 앤트로픽과 협상이 깨진 그날 샘 올트먼(오픈AI CEO)이 피트 헤그세스를 만나 앤트로필이 못하겠다고 한 걸 해주겠다고 제안했다.

- 샘 올트먼은 “모든 합법적인 사용을 허용하겠다”면서도 “원칙은 달라지지 않았다”고 주장했다. 가장 중요한 두 가지 원칙이 대량 감시 금지와 인간의 책임성인데 국방부도 여기에 동의했다는 이야기다. 합법과 불법의 문제는 아니다. 결국 원칙에 얼마나 엄격하느냐의 차이다.

- 샘 올트먼은 “민간 미국 기업이 민주적으로 선출된 미국 정부보다 더 강력한 권한을 가질 수 없다”는 애매한 말을 남겼다.

클로드 마케팅 도와주는 트럼프.

- 어쨌거나 미국 국방부가 클로드를 먼저 선택했다는 건 클로드가 다른 모델보다 훨씬 뛰어나다고 본다는 의미다.

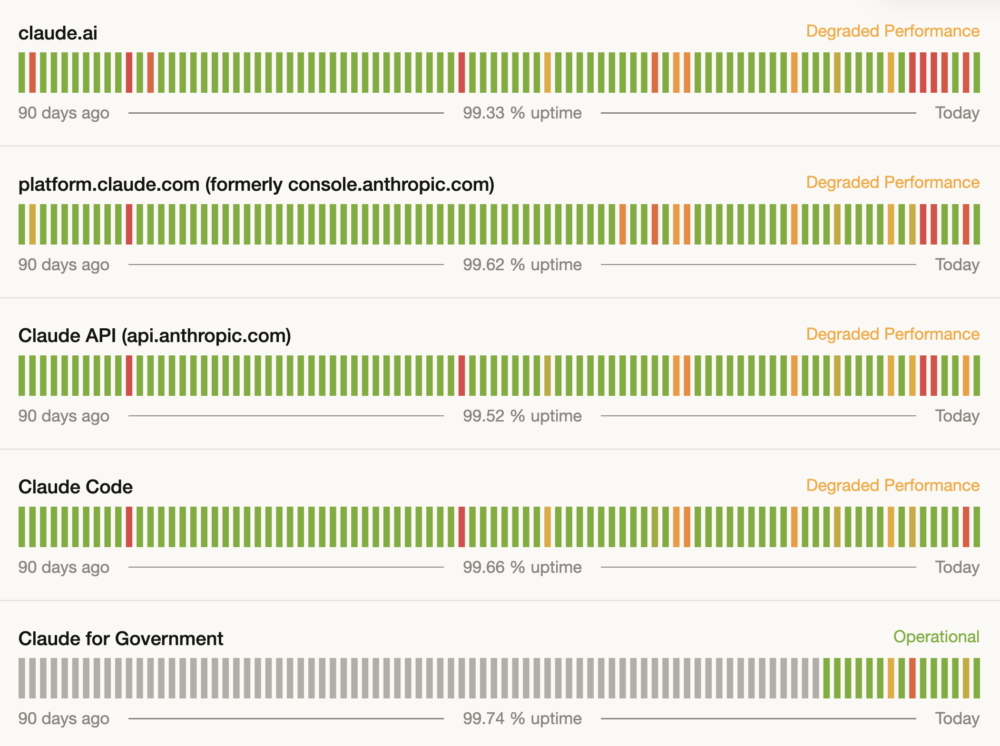

- 클로드가 퇴출됐다는 소식이 알려진 뒤 클로드가 미국 다운로드 수 1위를 기록했다.

- 3일에는 이용자가 폭주해 하루 종일 접속 불량이 계속되고 있다.

- 구글과 오픈AI 직원들이 앤트로픽을 지지하는 성명을 내기도 했다. 배후에 일론 머스크(테슬라 CEO)의 xAI가 있다는 이야기도 나온다. 일론 머스크도 클로드가 못하겠다고 한 걸 해주겠다고 제안할 가능성이 있다.

- 오픈AI가 챗GPT 5.3 갈릭을 곧 출시한다. 클로드 코워크를 뛰어넘을 수 있을까.

- QuitGPT, 챗GPT 탈퇴 운동도 퍼지고 있다.

짧은 켄타우로스 단계.

- 제임스 왕(세라브라스 마케팅 디렉터)은 “25년 동안 기술 분야를 지켜봐 왔지만, 코덱스+클로드를 사용하는 100만 명과 나머지 인류 사이의 격차가 이토록 크게 느껴진 적은 없었다”고 말했다.

- 켄타우로스 단계라는 말도 나온다. 지금은 반인반수의 상태지만 곧 AI 단독으로 인간을 능가하게 될 거라는 이야기다.

- 개리 탄(와이콤비네이터 CEO)은 “CEO들이 10명의 일을 하는 시대”라고 말했다.

오픈AI와 앤트로픽의 다른 철학.

- 오픈AI 멤버 가운데 일부가 나가서 만든 회사가 앤트로픽이다. 앤트로픽은 가장 안전한 AI가 동시에 최고의 AI가 될 것이라는 철학에서 출발했다.

- 2023년 샘 올트먼 퇴출을 주도했던 효과적인 이타주의자들(Effective Altruists)은 대부분 떠났다. 일리야 수츠케버도 퇴사해서 AI 안전을 다루는 스타트업 SSI를 창업했다.

- 오픈AI에 있던 강경한 이타주의자 그룹은 대부분 앤트로픽으로 옮겼다. 오픈AI는 가속주의자 그룹이 지배하고 있는 상태다.

- 앤트로픽이 구성적인(Constitutional) AI를 지향하면서 AI의 윤리를 강조하는 것과 달리 오픈AI는 인간의 통제를 강조한다. 앤트로픽은 여전히 AI를 의심하고 경계하는데 오픈AI는 쓰기 나름이라는입장이다.

이란 공격에 클로드를 썼나.

- 월스트리트저널에 따르면 헤그세스가 계약을 중단하겠다고 선언한 뒤에도 미국 국방부는 클로드를 썼다.

- 이란을 공격할 때 미국과 이스라엘은 네트워크를 먼저 장악했고 위성 정보와 CCTV, 통신 데이터를 취합해 하메네이의 위치를 정확하게 파악하고 있었다. 클로드는 데이터를 취합해 패턴을 식별하고 작전 시나리오 시뮬레이션을 설계하는 역할을 했다.

- 미국 국방부의 임팩트 레벨 6에 접근하는 유일한 프론티어 AI 모델이 클로드다.

- 가디언은 “생각의 속도보다 빠른 폭격의 시대가 열렸다”면서 “인간 의사 결정권자들이 배제될 수도 있다”고 경고했다.

- 팔란티어가 머신러닝 기반으로 표적을 식별하고 우선 순위를 정한다면 클로드는 정보를 분석하고 의사 결정을 지원하는 역할을 한다.

- 데이비드 레슬리(퀸메리대 교수)는 “AI 의존이 늘면 인지적 경감 효과가 나타나는데 공격 결정의 부담을 덜 느끼게 된다”고 지적했다.

거대한 논쟁의 시작.

- AI가 안보 문제가 됐다.

- 과거에 어떤 미사일을 쏠 것인가가 전쟁의 성격을 결정했다면 이제 어떤 철학을 가진 AI를 쓸 것인가가 중요하다.

- 헤그세스는 “전쟁을 방해하는 AI는 도입하지 않겠다”고 했다. 깨어 있지 않을 것(“Not Woke”; 소위 깨어 있는 ‘워크’ 군 문화 종식 선언)이라고도 했다.

- 테크폴리시에 따르면 미국 정부는 세 가지 방향에서 데이터를 활용하고 있을 가능성이 있다.

- 첫째, 안보목적으로 개인 정보를 대규모로 수집하고 있을 가능성,

- 둘째, 중개업체에서 데이터를 구입하고 있을 가능성,

- 셋째, 이렇게 확보한 데이터를 결합해 통찰을 생성하고 있을 가능성이다.

- 컨버세이션은 “인공지능 윤리는 민주적 규범을 전제로 한다”고 강조했다. 민주주의에서 궁극적인 권력은 국민에게 있다. 국민들은 시스템이 어떻게 작동하는지 알아야 한다는 이야기다. 앤트로픽은 논의가 필요하다고 제안했고 트럼프는 걷어차 버린 상태다.

앤트로픽의 Constitutional AI에서 constitutional은 헌법과 관련된 의미에 가깝습니다. AI가 인간의 가치와 맞도록 ‘정렬alignment’하는 것이 AI윤리 분야에서 화두인데, 일종의 정렬 방식으로서 세계인권선언 등 기본적인 윤리원칙들을 토대로 모델을 훈련시키는 것입니다.

그리고 앤트로픽과 달리 오픈 AI가 인간의 통제를 강조한다는 표현이 잘 와닿지 않습니다. 앤트로픽의 방향 또한 AI에 대한 인간(개발자)의 통제를 강조하는 것 아닌가요. 오픈 AI는 앤트로픽과 비교하면 윤리에는 별 관심 없고 AI 기술과 사용자의 자율성을 최우선에 두는 것 같습니다.