[AI in a Week by TechFrontier] 한 주일의 주요 AI 뉴스, 논문, 칼럼을 ‘테크프론티어’ 한상기 박사가 리뷰합니다. (⏰20분)

지난주에는 여러 기업의 실적 발표와 펀딩 상황에 관한 뉴스가 많았다.

요즘 실리콘 밸리의 인재 전쟁은 상상을 초월하는 금액이 오가서 마치 NBA 스타들을 스카우트하는 것 같다는 이야기도 나오지만, 정작 들여다보면 진짜 리더가 있는 회사나 컬트적인 문화가 존재하는 회사는 흔들리지 않는다는 분석도 나온다.

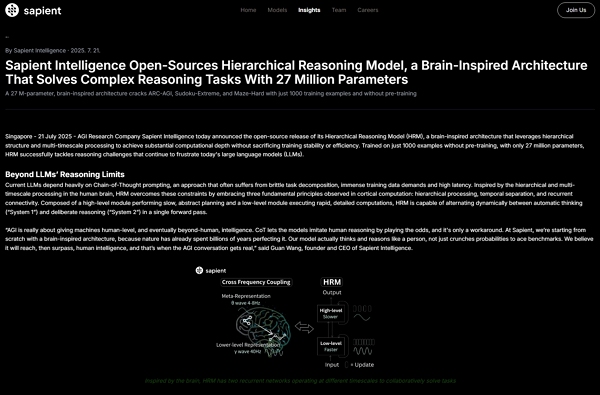

가상 과학자(에이전트)를 통한 코로나 백신 개발 가능성을 연구한 논문이 큰 이목을 집중시켰다. 그리고 싱가포르의 새피언트 인텔리전스가 발표한 계층적 논증 모델(HRM)은 트랜스포머 구조를 넘어서는 새로운 접근으로 AI 분야에서 가장 중요한 논문이 될 수도 있다는 극찬을 받았다. 작은 스타트업이 이런 거창한 발표를 하는 배포가 부러웠다. 국내에도 이런 스타트업이 탄생할 수 있기를 바란다.

미국 미디어가 중국 AI 생태계에 관심을 주기 시작했지만, 중국이 발표한 글로벌 AI 거버넌스 액션 플랜은 그렇게 큰 주목을 받지 못했다. 너무 좋은 말로만 쓰여 있어서 더 믿기가 어려운 면이 있다. 국가대표 AI 기업 선발이 진행되면서 국내 여러 기업에서 오픈 소스와 새로운 모델 발표를 의도적으로 했는데 1차를 거쳐 2차 선발이 이루어지는 중이라 지난주에는 특별히 주목할 만한 발표는 없었다.

여러 흥미로운 논문이 있었는데, 모두 옮길 수가 없어서 아쉽다. 소개를 못 했지만 링크는 제공한다.

- AgentSociety: An Open Source AI Framework for Simulating Large-Scale Societal Interactions with LLM Agents – MarkTechPost

- https://arxiv.org/pdf/2507.21046 (A SURVEY OF SELF-EVOLVING AGENTS)

- https://arxiv.org/pdf/2507.22358 (Magentic-UI: Towards Human-in-the-loop Agentic Systems)

1. AI 인재 전쟁: NBA 스타 같은 연봉 패키지, 10억 달러 제안 거절한 이유

- 저커버그의 10억 달러 제안을 거절한 소식을 전한 WSJ (8월 1일)

빅테크들이 AI 연구자를 확보하기 위한 인재 확보 전쟁을 벌이고 있다는 뉴욕타임스 기사다.

24살의 맷 데이트케는 메타의 초지능 연구 프로젝트에 조인하면 4년 간 1억 2,500만 달러의 주식과 현금을 지급하겠다는 저커버그의 전화를 받았다. 버셉트(Vercept)라는 스타트업을 창업한 그는 그 제안을 거절했으나(버셉트는 이미 에릭 슈미트 등으로 부터 1,650만 달러를 투자 받았다) 이후 다시 저커버그는 직접 만나서 4년에 2억 5천만 달러를 제안했고 친구들과 의논한 후 데이트케는 이 제안을 받아들였다. 데이트케는 이 전에 앨런 AI 연구소에서 연구진으로 있었고, Molmo, ProcTHOR, Objaverse, Phone2Proc 개발을 주도했던 사람이다.

NBA 선수들과 달리 메타, 오픈AI, 구글은 연봉 상한선이 없어서 젊은 엔지니어들은 비공식 에이전트나 친구들과 전략을 짜고 있다고 한다. 또한 각 회사는 경쟁사의 엔지니어를 수시로 빼내고 있다. 마이크로소프트는 최근 6개월 동안 딥마인드의 직원 20명을 스카우트 했다고 한다.

이렇게 되는 이유 중 하나는 극소수 기업만이 사용할 수 있는 엄청난 컴퓨팅 파워를 실제로 경험해 본 연구자가 많지 않기 때문이다(우리로서는 뼈 아픈 이야기이다). 저커버그는 초지능이 우리가 할 수 있는 모든 일을 개선할 것이라는 확신이 있다는 이야기를 했고, 이런 인재에 의해 매출이 0.5%가 증가한다면 그 리턴이 엄청날 것이기 때문에 몇 억 달러를 쓰는 일은 아무것도 아니라는 입장이다.

메타는 최고의 인재들에게 돈보다 더 매력이 있는 컴퓨팅 파워 제공을 조건으로 제시했다고 한다. 일부 채용 후보자들에게 AI 연구를 위해 3만 개의 GPU가 할당될 것이라는 말이 내부에서 들린다고 한다. 저커버그는 최고 인재에 대한 리스트를 만들어 채용에 나섰고 이 리스트에 올라간 후보들은 슬랙과 디스코드에 채팅 그룹을 만들어 제안에 대해 서로 논의했다고 한다.

오픈AI는 이런 환경 때문에 내부 보상 구조를 변경했다고 한다. 메타는 오픈AI 직원 100명 이상에게 연락을 취했고, 최소 10명을 채용했다. 7월 25일, 저커버그는 오픈AI에서 3년간 근무한 중국 연구원 셩지아 자오를 메타의 새로운 초지능팀 책임자로 임명하기도 했다.

또 다른 이야기도 있다. 월스트리트 저널의 8월 1일자 뉴스에 따르면 저커버그는 오픈AI의 CTO였던 미라 무라티가 세운 씽킹 머신즈 랩을 인수하겠다고 제안했고 미라가 거절하자 무라티의 회사 직원 50명 가운데 12명을 만나서 이직을 제안했다고 한다. 주요 타깃은 공동 창업자였던 앤드류 툴로치(Andrew Tulloch)였고 그에게 10억 달러의 패키지를 제시했다. 주가 실적을 고려하면 6년 동안 최대 15억 달러에 달할 수 있는 패키지였으나 그가 거절했다. 씽킹 머신즈에서는 아무도 떠나지 않았다고 한다.

월스트리트저널은 일부 AI 연구자들이 더 많은 급여와 권력을 추구하며 연구소를 전전하며 자유계약선수처럼 행동하지만, 상당수는 자신이 선택한 리더들에게 흔들리지 않는 충성심을 보인다고 한다.

앤스로픽은 오픈AI의 핵심 인력들이 나와서 만들었고 공동 창업자 7명이 아직도 회사에 남아 있다. 이들은 효과적 이타주의라는 끈끈한 공동체로 뭉쳐있는 그룹이고 회사 직원들도 그 정신에 공감하는 사람들이 많아서 저커버그에 이 회사에서 사람들을 빼내기는 쉽지 않다.

오픈AI를 나와서 안전한 초지능을 만들겠다고 SSI를 세운 일리야 수츠케버는 메타의 인수 제의도 거절하고, 자기 엔지니어를 지키기 위한 노력을 한다. 일단 그는 오픈AI 출신 연구진 대신 자신의 멘토링이 필요한 알려지지 않은 엔지니어를 뽑았고, 이들의 링크드인 이력에 SSI를 언급하지 않게 했다고 한다.

미라 무라티도 자신을 따르는 사도들을 거느리고 있고 알바니아 출신인 무라티의 감성과 겸손함이 이들이 미라 무라티를 따르게 하고 있다고 한다. 더군다나 무라티가 오픈AI를 나올 때 20명 정도의 직원이 따라 나왔는데, 미라는 초기에 조인에 첫 제품 출시을 이끌었고 CTO로서 모든 측면을 끌고 나가는 리더십을 보였다고 한다.

저커버그가 자금과 GPU로 연구원들을 흔들어 대고 있고, 마이크로소프트는 딥마인드를 겨냥하고 있어도, 같은 철학을 갖고 있거나 벨 연구소 처럼 수평적이고 동료애가 넘치는 직장을 만든 리더들에게는 아직 빅 테크의 제안이 쉽게 먹히지 않고 있다.

2. 커피 한잔 마실 시간에 수백 건의 연구 토론, 가상 실험실이 생물학 난제 푼다

스탠포드 의대와 병원을 통합해 칭하는 스탠포드 메디신도 나서서 소개한 연구 결과이다. 생물의학 데이터 사이언스 부교수 제임스 주 박사팀이 AI 에이전트로 구성된 마치 최고 수준의 과학자들이 문제에 대해 비판적으로 생각하고, 특정 질문을 연구하고, 특정 전문 분야에 기반하여 다양한 해결책을 제시하고, 서로 아이디어를 교환하여 검증할 가치가 있는 가설을 개발하는 방식과 동일하게 AI 에이전트를 학습시켰다.

주 교수의 팀은 COVID-19를 유발하는 바이러스인 SARS-CoV-2 백신을 개발하는 더 나은 방법을 고안하도록 “팀”에 과제를 부여한 후 AI 연구실의 잠재력을 입증했다. AI 연구실은 이 작업에 단 며칠밖에 걸리지 않았다.

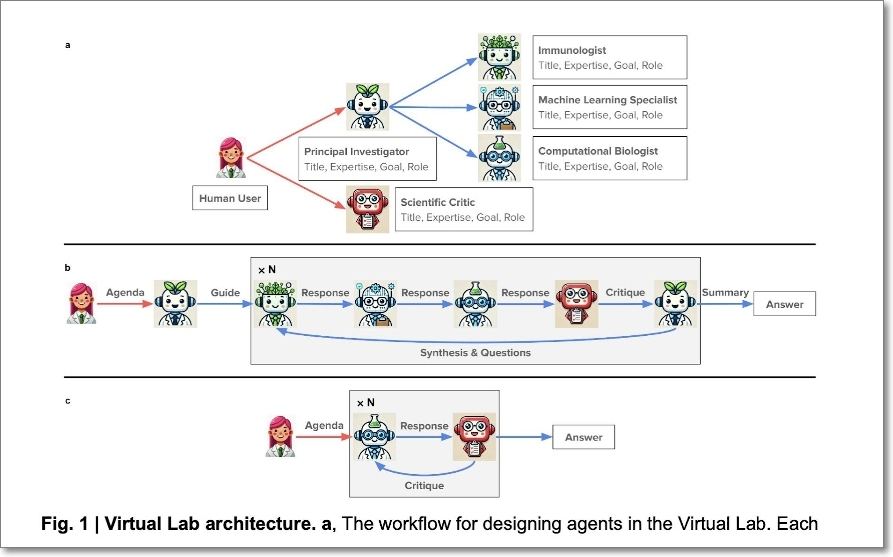

인간 연구자가 AI 책임 연구자(AI PI)에게 과학적 과제를 제시하면, AI PI가 그 과제를 수행한다. AI PI의 역할은 프로젝트에 필요한 다른 에이전트와 전문 지식을 파악하는 것이다. 예를 들어 SARS-CoV-2 프로젝트의 경우, PI 에이전트는 면역학 에이전트, 계산 생물학 에이전트, 그리고 머신러닝 에이전트를 만들었다. 모든 프로젝트에는 주제와 관계없이 비판적인 역할을 하는 에이전트가 하나씩 있는데, 이 에이전트의 역할은 허점을 파고들고, 흔히 저지르는 실수에 대해 경고하고, 다른 에이전트들에게 건설적인 비판을 제공하는 것이다.

제임스 주 교수 팀은 가상 과학자들에게 단백질 모델링 AI 시스템인 알파폴드와 같은 도구와 소프트웨어 시스템을 제공하여 창의적인 “사고” 능력을 더욱 자극했다. 에이전트들은 심지어 자신만의 위시리스트를 만들기도 했는데, 제임스 주 교수는 “그들이 특정 도구에 대한 접근 권한을 요청하면, 저희는 모델에 해당 도구를 내장하여 사용할 수 있도록 했습니다.”라고 말했다.

가상 실험실은 에이전트들이 아이디어를 내고 서로 대화를 나누는 정기 회의를 갖는다. 또한, 랩 구성원들이 PI 에이전트와 개별적으로 만나 아이디어를 논의할 수 있도록 일대일 회의도 진행한다. 이 모든 회의는 몇 초나 몇 분 안에 이루어진다. “제가 아침 커피를 마실 때쯤이면 그들은 이미 수백 건의 연구 토론을 했습니다.”라고 주 교수는 말했다고 한다. 가상 실험실에서 이루어지는 모든 회의, 교류, 상호작용은 필사본으로 기록되며, 이를 통해 인간 연구자가 진행 상황을 추적하고 필요한 경우 프로젝트를 재지정할 수 있다.

팀은 AI 연구원들이 설계한 나노바디 구조 설계를 가져와 실제 실험실에서 직접 제작했다. 나노바디가 실험적으로 실현 가능하고 안정적이라는 것을 확인했을 뿐만 아니라, 새로운 SARS-CoV-2 변이체 중 하나에 결합하는 능력(새로운 백신의 효과를 결정하는 핵심 요소)도 시험했다. 그 결과, 실험실에서 설계된 기존 항체보다 바이러스에 더 강하게 부착되는 것을 확인했다. 현재 제임스 주 교수와 그의 팀은 나노바디가 새로운 백신 개발에 기여할 수 있는 능력을 분석하고 있다.

좀 더 기술적인 설명은 ETRI 전종홍 책임의 포스팅을 참고하기 바란다.

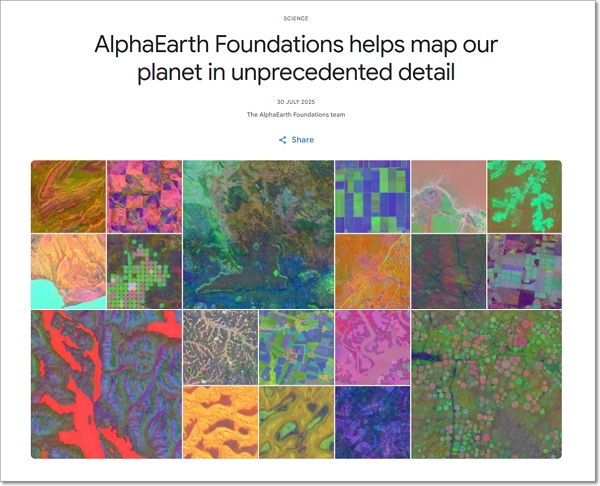

3. 알파어스 파운데이션즈, 가상 위성처럼 작동하는 인공지능 모델

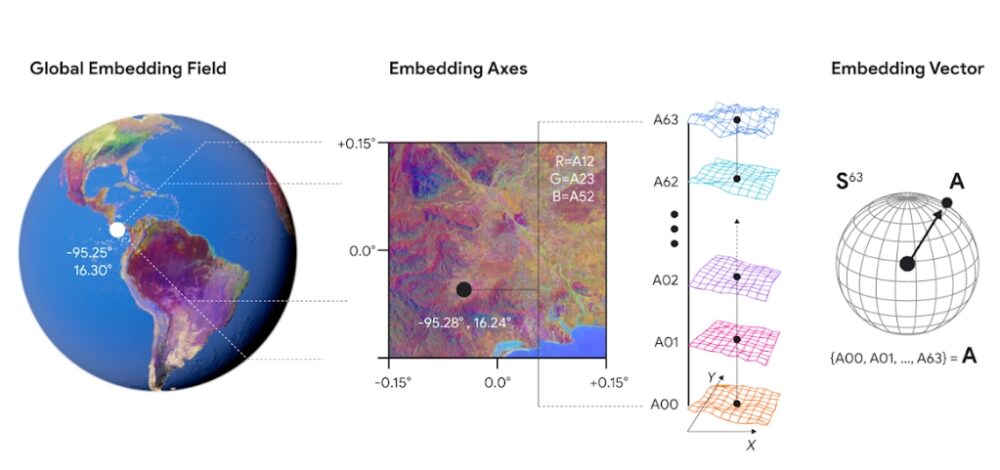

딥마인드가 페타바이트 규모의 지구 관측 데이터를 통합하여 글로벌 매핑 및 모니터링에 혁명을 일으키는 대규모 데이터를 기반으로 한 알파어스 파운데이션즈 모델을 공개했다. 방대한 양의 지구 관측 데이터를 컴퓨터 시스템이 쉽게 처리할 수 있는 통합 디지털 표현, 즉 ‘임베딩’으로 통합하여 지구 전체의 육지와 연안 해역을 정확하고 효율적으로 분석할 수 있게 하겠다는 것이다. 이를 통해 이 모델은 과학자들에게 지구의 진화에 대한 더욱 완전하고 일관된 그림을 제공하여 식량 안보, 삼림 벌채, 도시 확장, 수자원과 같은 중요한 문제에 관해 더욱 정보에 기반한 결정을 내릴 수 있도록 지원한다.

알파어스는 광학 위성 이미지, 레이더, 3D 레이저 매핑, 기후 시뮬레이션 등 수십 가지의 다양한 공공 출처에서 얻은 방대한 정보를 결합한다. 이 모든 정보를 결합하여 10×10미터 크기의 선명한 정사각형으로 전 세계 육지와 연안 해역을 분석하고, 시간 경과에 따른 변화를 놀라울 정도로 정밀하게 추적하도록 한다.

두 번째로 이 데이터를 실용적으로 사용할 수 있게 해준다. 이 시스템의 핵심 혁신은 각 칸에 대해 매우 간결한 요약을 생성할 수 있다. 이러한 요약은 딥마인드가 테스트한 다른 AI 시스템에서 생성된 요약보다 저장 공간이 16배나 적게 필요하며, 전 지구적 규모의 분석 비용을 획기적으로 절감한다.

이를 통해 과학자들은 지금까지 불가능한 일을 할 수 있게 되는데, 바로 필요에 따라 상세하고 일관된 세계 지도를 제작하는 것이다. 작물 건강 상태를 모니터링하든, 삼림 벌채를 추적하든, 새로운 건설 현장을 관찰하든, 더 이상 머리 위를 지나가는 단일 위성에만 의존할 필요가 없다. 이제 공간 데이터를 위한 새로운 기반을 확보하게 된 것이다.

실제 사용에 적합한지 확인하기 위해 엄격한 성능 테스트를 위해 기존 방식 및 기타 AI 매핑 시스템과 비교했을 때, 알파어스 파운데이션즈는 항상 가장 정확한 결과를 보여줬다고 한다. 테스트 대상 모델보다 오류율이 24% 낮아 뛰어난 학습 효율성을 보여주었다. 자세한 내용은 논문에서 확인할 수 있다.

알파어스 파운데이션즈에서 지원하는 구글 어스 엔진의 위성 임베딩 데이터세트는 연간 1조 4천억 개 이상의 임베딩 데이터를 보유한 동종 최대 규모의 데이터세트이며 전 세계 기관과 연구소에서 사용하고 있다. 예를 들어, 세계 생태계를 지도화하고 모니터링하는 최초의 종합적인 자료 구축을 목표로 하는 이니셔티브인 글로벌 생태계 지도(Global Ecosystems Atlas) 는 이 데이터 세트를 활용하여 각국이 지도로 나타나지 않은 생태계를 해안 관목지 와 초건조 사막 과 같은 범주로 분류할 수 있도록 지원하고 있다.

앞으로 제미나이 같은 일반 추론 LLM과 결합하면 더욱 유용하게 사용할 수 있을 것이다.

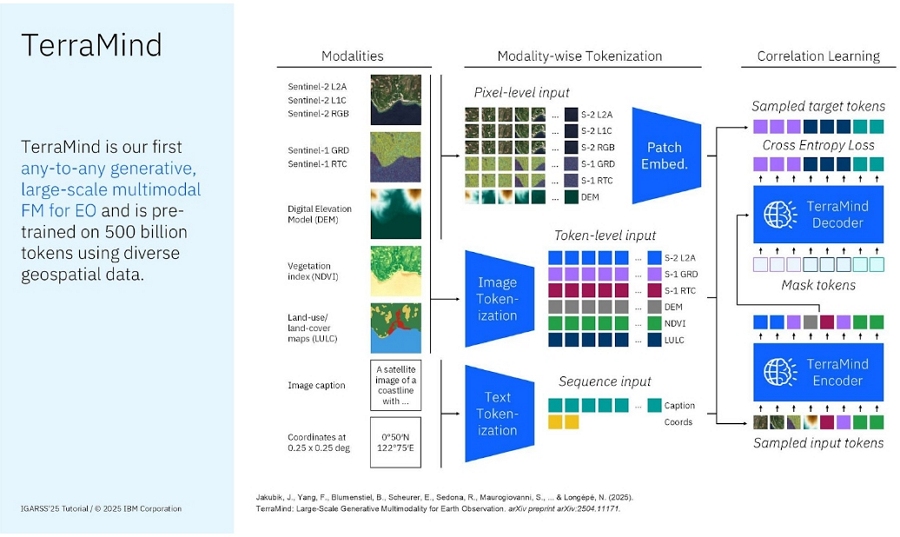

공간 정보를 위한 또 다른 소식은 이노팸의 이임평 CEO가 알린 소식으로 IGARSS2025 튜토리얼에 소개한 나사(NASA)의 파운데이션 모델 ‘Prithvi-EO’이다. 나사와 IBM 연구소가 협력하여 구축한 Geospatial Foundation Model (GeoFM)로, Sentinel-2와 랜샛 위성 데이터를 통합하여 전 세계 30m 해상도의 근실시간 표면반사 데이터를 커버한다. 1억~3억 파라미터 규모의 모델로 거대한 시계열 EO 아카이브를 self-supervised 방식으로 학습하여 다양한 응용에 재사용 가능하다. AWS, 허깅 페이스, 나사 시스템에서 사용이 가능하다고 한다.

또 다른 사례로는 IBM과 ESA가 공동 개발한 테라마인드(TerraMind)가 있다. 주어진 입력만으로 부족할 때, 다른 모달리티 데이터를 ‘상상해서’ 생성하고 이를 함께 활용해 파인 튜닝 성능을 높이는 방식인 ‘Thinking-in-Modalities’을 사용한다. 허깅 페이스에 공개되어 있다.

지구 전역의 정보를 분석하기 위한 공간 정보 파운데이션 모델(GeoFM)에 대한 개발이 이루어지고 이런 모델을 전 세계 연구자들의 공동 자산으로 활용할 수 있다는 시대가 되었다. 이를 기존의 논증 모델이나 에이전트 모델과 결합하면 아주 흥미로운 결과들이 나올 것 같다.

4. 새피언트 인텔리전스의 계층적 리즈닝 모델(HRM)

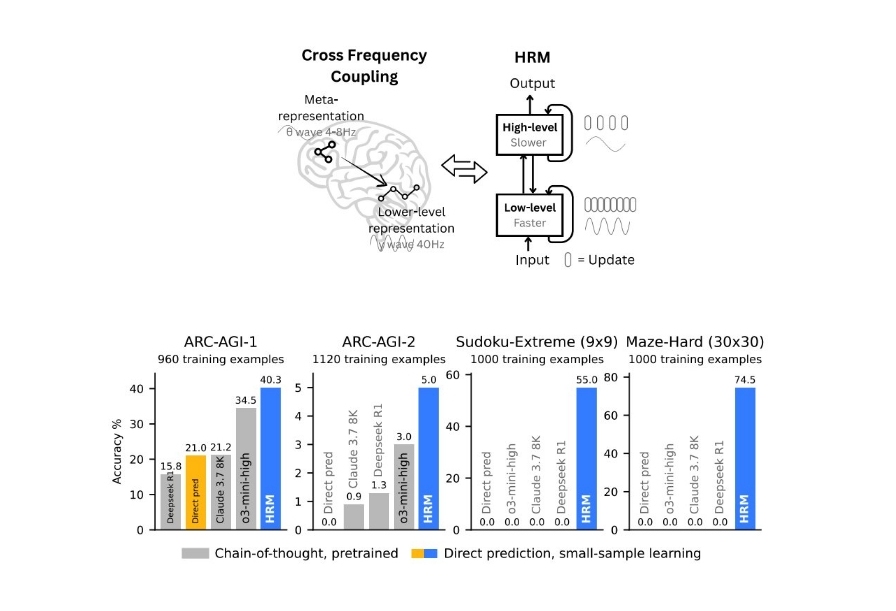

싱가포르에 본사를 두고 샌프란시스코와 베이징에 연구 센터를 둔 글로벌 AGI 연구 기업인 새피언트 인텔리전스가 발표한 한 논문이 엑스와 여러 AI 그룹에서 조용히 파문을 일으키고 있다. 트랜스포머 구조를 넘어서는 새로운 접근이고 AI 분야에서 가장 중요한 논문이 될 것이라는 극찬도 받고 있다.

일단 2,700만 개의 파라미터를 갖는 작은 모델이고 단지 1,000개의 샘플로 학습을 했음에도 o3-미니-하이 모델을 넘어서는 논증(리즈닝) 성과를 보였기 때문이다. ARC-AGI에서 40% 정확도, 어려운 수준의 스도쿠와 메이즈에서 완벽한 점수를 보였기 때문이다.

일단 이들은 기존 LLM의 한계, 특히 CoT의 한계인 취약한 작업 분해, 방대한 데이터 요구, 높은 지연 시간 문제를 해결했고, LLM의 얕은 아키텍처, 소실 경사 문제, 고전적인 순환 아키텍처 문제 등을 벗어났다고 주장한다.

HRM은 인간 뇌의 계층적이고 다중 시간 스케일 처리에서 영감을 받아 설계했다고 한다. 여기에는 두 개의 상호의존적 순환 모듈이 있는데, 먼저 고수준(H) 모듈로 느리고 추상적인 계획 및 의도적인 추론을 담당한다. 저수준 모듈이 여러 계산 단계를 완료하고 지역 평형에 도달한 후에만 업데이트된다. 다음 저수준 모듈(L)로 빠르고 상세한 계산을 처리하며, 집중적인 탐색 또는 개선 작업을 수행한다. 각 시간 단계마다 자신의 이전 상태, H-모듈의 현재 상태, 그리고 입력 표현에 따라 상태를 업데이트한다. 이런 구조는 모델의 유효 계산 깊이를 크게 증가한다.

또 다른 차이점은 계층적 수렴으로 각 주기 동안 L-모듈은 안정적으로 지역 평형에 수렴하고, H-모듈은 이 L-모듈의 최종 상태를 사용하여 업데이트를 수행하여 L-모듈의 계산 경로를 ‘재시작’하고 새로운 수렴 단계를 시작한다. 이를 통해 H-모듈이 전반적인 문제 해결 전략을 지시하고 L-모듈이 각 단계에 필요한 집중적인 계산을 실행하는 일련의 별개적이고 안정적인 중첩 계산이 가능해진다.

세 번째 특성은 원스텝 경사 근사(One-step Gradient Approximation)로 BPTT(Backpropagation Through Time)의 과도한 메모리 부담(O(T))과 생물학적 비현실성 문제를 해결한다. 이를 통해 메모리 사용량이 상수(O(1))로 유지되어 대규모 네트워크에서도 확장이 가능하며 생물학적으로 더 그럴듯하다는 것이다. 이는 딥 이퀼리브리엄 모델(DEQ)의 수학적 이론에 기반을 둔다.

네 번째는 뇌에서 주기적인 신경 진동이 학습을 조절하는 원리에서 영감을 얻은 심층 감독 기능으로 HRM 모델의 여러 순방향 패스(세그먼트)를 실행하고, 각 세그먼트가 끝날 때마다 손실을 계산하고 매개변수를 업데이트한다.

적응형 계산 시간(Adaptive Computational Time, ACT) 개념은 뇌가 작업 복잡성에 따라 “생각하는 시간”(System 1: 빠르고 자동적인 생각, System 2: 느리고 의도적인 추론)을 동적으로 조절하는 방식에서 영감을 얻었다. Q-러닝 알고리즘을 사용하여 필요한 계산 세그먼트의 수를 적응적으로 결정한다. 이를 통해 계산 자원을 효율적으로 절약하면서도 성능에 미치는 영향은 최소화한다.

가장 흥미로운 점은 뇌의 계층적 처리와 유사하게, 학습된 HRM은 고수준 모듈(zH)이 저수준 모듈(zL)보다 훨씬 높은 차원의 표현 공간에서 작동하는 ‘차원 계층’을 나타낸다. 이는 인지적 유연성에 중요하다고 여겨지는 특성이며, 학습을 통해 나타나는 현상임이 입증되었다고 한다.

간략하게 얘기하면 현재 LLM이 토큰을 기반으로 논증하기 때문에 초기에 실수하면 모든 것이 무너지기도 하고 실제 인간의 ‘생각’과 다를 수 있지만 HRM은단어를 생성하는 것이 아니라 아이디어를 내부에 간직하면서 지속적으로 개선하는 방식이다. 이를 표현의 사슬(CiR: Chain-in-Representation)이라고 부른다.

HRM 논문을 한 마디로 이렇게 설명하는 사람도 있다.

동 원리 (뇌에서 영감을 받은):

→ 저수준 계산용 고속 모듈

→ 고수준 계획용 저속 모듈

→ 시간이 지나며 반복된다

→ 각 고수준 업데이트는 고속 모듈에 새로운 방향을 제공한다

그러나 아직 이들이 인정하는 추가 연구가 필요한 부분은 다음과 같은 이슈들이다.

- 내부 추론 알고리즘에 대한 불명확성: HRM은 복잡한 추론 작업에서 강력한 성능을 보여주지만, “HRM 신경망이 실제로 어떤 추론 알고리즘을 구현하는지에 대한 명확한 답은 현재 연구 범위 밖”이라고 명시하고 있다. 모델의 성능은 우수하지만, 그 내부에서 어떤 구체적인 알고리듬적 추론이 일어나는지에 대한 해석 가능성(interpretability)은 아직 초기 단계이다.

- 계층적 차원 조직의 인과적 필연성: HRM은 뇌의 계층적 처리 방식에서 영감을 받아 고수준 모듈(zH)이 저수준 모듈(zL)보다 훨씬 높은 차원의 표현 공간에서 작동하는 ‘차원 계층’을 나타낸다. 그러나 논문에서는 “이러한 증거는 상관관계일 뿐”이라고 강조하며, 고수준 모듈의 차원을 제한하는 등의 개입을 통해 인과적 연관성을 테스트할 수 있지만, 이는 딥러닝 훈련 과정에 대한 잠재적인 교란 효과 때문에 해석하기 어렵다고 언급한다. 따라서 “이러한 창발적(emergent) 계층 구조의 인과적 필연성은 향후 조사를 위한 중요한 질문으로 남아있다”고 밝히고 있다.

- 계층적 메모리 통합 가능성: HRM은 추론에 초점을 맞추고 있으며, 단순화를 위해 전체 어텐션(full attention)을 사용한다. 논문에서는 뇌가 기억을 처리하는 방식에서도 계층적 다중 시간 스케일 구조가 중요한 역할을 한다고 언급하며, “HRM에 계층적 메모리를 통합하는 것이 유망한 미래 방향이 될 수 있다”고 제안한다. 이는 현재 HRM이 계층적 메모리의 모든 잠재력을 완전히 활용하고 있지는 않을 수 있음을 시사하며, 개선의 여지를 남긴다.

그 동안 트랜스포머 아키텍처와 CoT 프로세스를 넘어선다는 논문이 가끔 나왔지만 이 팀의 결과가 매우 신선하다. 깃허브에 올라 왔으니 많은 사람들이 검증을 할 것이라고 본다. 이 회사가 눈에 띄는 점은 딥마인드, 딥시크, xAI, 앤스로픽 출신들이고 칭화대, 베이징 대학, UC 버클리, 캠브리지, 앨버타 대학의 연구진들로 이루어진 젊은 팀이라는 점이 매력적이다. 국내에서도 이런 주장을 하는 젊은 연구진 그룹이 나타나길 진정으로 바란다.

5. 싱가포르의 AI 안전 보고서

ETRI 전종홍 책임이 알려준 보고서이다. 일반적으로 싱가포르의 AI 연구와 정책 수준은 우리를 넘어선다는 평가를 받는다. 콘코디아 AI는 글로벌 AI 안전 및 거버넌스를 전문으로 하는 사회적 기업이다. 단순히 AI 기술을 개발하는 것을 넘어, AI가 인류에게 안전하고 이롭게 사용되도록 국제적인 논의와 정책 수립에 기여하는 데 초점을 맞추고 있다. 싱가포르와 베이징에 사무실을 두고 있으며, 전 세계의 AI 전문가 및 정책 입안자들과 협력한다.

이 보고서는 싱가포르의 AI 안전 생태계를 국내외 정책, 산업 현황, 기술 연구, 대중 인식 등 다섯 가지 영역으로 나누어 종합적으로 분석한 보고서이다. 전종홍 책임이 정리한 내용은 다음과 같다:

“2025년 7월에 발간된 싱가포르 AI 안전 현황 보고서는 싱가포르의 AI 안전 생태계에 대한 최초의 종합적인 분석을 제시한다. 이 보고서는 싱가포르처럼 규모가 작고 자원이 부족한 국가들이 새로운 AI 안전 규범을 형성하는 데 여전히 의미 있는 역할을 할 수 있음을 보여준다.”

1. 국내적 접근법(Domestic Approach)

- 자발적 AI 거버넌스 프레임워크:

- 2019년 세계 최초로 “모델 AI 거버넌스 프레임워크(Model AI Governance Framework, MGF)”를 발표했다

- 2024년에는 생성형 AI까지 확장된 프레임워크(MGF-GenAI)를 제시했다.

- AI 위험을 평가하는 위해성(harm) 평가 행렬 활용하여 위험의 심각도와 확률을 평가하여 인간 개입 수준을 결정했다.

- AI 안전성 테스트 및 보증:

- “AI Verify” 프레임워크를 통해 공정성, 설명 가능성, 강건성 등 다양한 요소를 테스트하고 검증했다.

- “Project Moonshot”(p.16), “Global AI Assurance Pilot”(p.17) 등의 프로젝트를 통해 생성형 AI 모델과 애플리케이션의 평가 및 안전성 강화를 위한 노력을 했다.

- 규제:

- 광범위한 AI 규제가 아닌 선거 관련 딥페이크 등 특정 AI 위험을 타겟으로 한 법률을 활용 중이다.

- 현재 국가 차원의 포괄적 AI 법률은 없다.

- 표준화 활동:

- ISO/IEC 42001 기반의 국가 표준 SS ISO/IEC 42001을 도입하여 AI 관리 체계를 확립했다.

2. 국제적 접근법(International Approach)

- 글로벌 AI 안전 논의에서 중재자 역할 수행한다:

- 영국 블레츨리 선언(Bletchley Declaration), 서울 선언(Seoul Declaration), 파리 AI 행동 정상회의(Paris AI Action Summit) 등 국제 행사에 적극 참여하여 글로벌 AI 안전 이니셔티브를 주도적으로 지원한다.

- ASEAN과의 협력:

- ASEAN AI 거버넌스 윤리 가이드 제작을 주도하며 동남아 국가들이 신뢰 가능한 AI 생태계를 구축할 수 있도록 지원한다.

- 양자 간 협력:

- 미국(NIST) 및 영국, EU 등과 AI 거버넌스 프레임워크 및 평가체계의 상호운용성을 확보하기 위한 협력 추진한다.

3. 산업 현황(Industry)

- 자국 개발 AI 모델:

- SEA-LION 및 MERaLION 모델 패밀리 개발을 통해 동남아시아 지역 언어 중심의 모델 개발에 주력한다.

- 모델의 안전성 관리가 아직 초기 단계로, 독성 평가와 SEA-Guard 프롬프트 필터 등 간단한 기능만 제공 중이다.

- AI 보증 산업 생태계:

- 다수의 현지 및 글로벌 기업이 모델, 애플리케이션, 조직 단위에서 AI 안전성 평가 및 보증 서비스를 제공하며 활발히 활동하고 있다.

- 외국 AI 개발 기업 유치:

- 구글, 메타, 알리바바, 텐센트, 오픈AI, 앤스로픽 등 주요 글로벌 AI 기업과 스타트업들이 싱가포르 내에 오피스나 연구센터를 설치하여 AI 안전성 평가 분야에서 협력 중이다.

4. 기술 연구(Technical Research)

- 주요 대학(NUS, NTU, SMU, SUTD) 및 정부 기관(A*STAR, GovTech)이 AI 안전성 기술 연구를 수행한다.

- 연구 초점 분야는 강건성(robustness), 멀티모달 모델 안전성, 지식 편집(unlearning), AI 에이전트 안전성 등이다.

- 특히 다중 모달 모델의 안전성 평가와 유해정보 제거 기술 연구가 활발하다.

5. 대중 인식(Public Opinion)

- AI 안전성에 대한 국민 의견 조사 데이터가 매우 제한적이다.

- 싱가포르 국민은 AI의 사이버 보안 위협, 개인정보 보호, 허위 정보 확산 등에 큰 우려를 나타낸다.

- 반면 편향성(bias), 공정성 등 윤리적 문제에 대한 우려는 상대적으로 적다.

콘코디아는 프론티어 AI 리스크 관리 프레임워크도 발표했다.

그 밖의 소식

- 미국이 AI 실행 계획(AAP)를 발표한 후 며칠 뒤 7월 26일에 중국에서 ‘글로벌 AI 거버넌스 액션 플랜’이 나왔다. 대부분의 내용이 매우 선언적이고 구체적인 액션을 담고 있지 못하다는 비판을 받는다. 미국에 대응해 서둘러 나온 듯한 느낌이다. 주요 메시지는 다음과 같으며 제목처럼 글로벌 AI 거버넌스를 위한 협력을 강조했지만 결국 중국과 함께 하자는 의미이다.

- AI의 기회를 공동으로 포착한다. 우리는 정부, 국제기구, 기업, 연구기관, 사회단체, 그리고 개인 시민을 포함한 모든 이해관계자의 적극적인 참여와 협력을 촉구한다.

- AI 혁신 개발을 촉진한다. 개방과 공유의 정신에 따라 과감한 실험과 탐구를 장려한다. 과학기술 협력을 위한 다양한 국제 플랫폼을 구축하고, 혁신 친화적인 정책 환경을 조성하며, 정책 및 규제 조율을 강화하고, 기술 협력과 연구 성과의 전환을 촉진하며, 기술 장벽을 낮추고 제거해야 한다.

- 산업 전반의 AI 역량 강화. 산업 제조, 소비, 상업 유통, 의료, 교육, 농업, 빈곤 퇴치 등 다양한 분야에서 AI 활용을 촉진하고, 자율주행 및 스마트 시티 등 다양한 시나리오에 AI를 접목하며, 다양하고 건강하며 선(善)을 지향하는 AI 활용 생태계를 조성해야 한다.

- 디지털 인프라 구축 가속화. 글로벌 청정 전력, 차세대 네트워크, 지능형 컴퓨팅 파워, 데이터 센터 등 인프라 구축을 가속화하고, 상호 운용 가능한 AI 및 디지털 인프라의 배치를 개선하며, 통일된 컴퓨팅 파워 표준 체계 구축을 추진한다. 특히 남반구 국가들을 지원한다.

- 다양하고 개방적이며 혁신적인 생태계를 조성해야 한다.

- 고품질 데이터 공급을 적극적으로 촉진한다.

- 에너지 및 환경 문제를 효과적으로 해결한다.

- 표준 및 규범에 대한 공통 이해를 증진한다.

- 공공 부문의 AI 도입 및 활용을 선도한다.

- AI 안전 거버넌스 강화한다.

- 글로벌 디지털 협약(Global Digital Compact) 공동 이행.

- AI 역량 강화를 위한 국제 협력 강화.

- 포용적인 다중 이해관계자 거버넌스 모델 구축.

- 여러 AI 기업의 매출 성과에 관련한 뉴스. 모두 디 인포메이션을 통해 나왔다.

- 중국의 지퓨의 매출이 올 상반기에 네 배가 되었다고 한다. 작년엔 단지 4,200만 달러였다.

- 캐나다 코히어는 연 매출 2억 달러 수준의 매출을 내고 있는데, 현재 63억 달러 평가로 펀딩 중이다.

- 앤스로픽의 연간 매출은 50억 달러에 육박하고 있는데 여기도 메가 라운드 중이다. 당초 30억 달러 수준을 유치하려고 했으나 투자자들의 관심이 커서 50억 달러까지 조달할 것으로 예상한다.

- 오픈AI는 연 매출 200억 달러를 예상하고 있으며 헷지 펀드 등으로 부터 83억 달러를 투자 받을 예정이다. 투자에는 드래곤니어, 알티미터 캐피털, D1 캐피털 파트너스 등이 참여했다. 오픈AI의 가치는 3000억 달러로 평가 받으며 올해 안에 400억 달러의 자금을 모을 계획이다.

- 프린스턴 대학의 역사학자 데이비드 벨이 뉴욕 타임스 오피니언란에 기고한 글이다 (NYT, 8월 2일). ‘AI가 계몽주의 가치를 버리고 있다.’

“AI가 계몽주의 시대만큼이나 심오한 지적 혁명을 가져올 수 있을까? 원조 계몽주의를 연구하는 역사가로서 두 시대를 면밀히 비교해보면, AI가 지적 생활에 얼마나 해로울 수 있는지, 그리고 계몽주의의 원칙 자체를 어떻게 훼손할 수 있는지를 명확히 알 수 있다. 가장 큰 차이는 볼테르가 얘기한 ‘참여’의 의미가 계몽주의와 AI가 말하는 ‘제2의 계몽주의’의 차이를 만들어 낸다. AI는 ‘그것은 틀린 질문입니다.’라고 말한 적이 없다. 계몽주의 저자들은 독자들이 텍스트와 씨름하는 것의 중요성을 이해했다. AI는 우리에게 유용한 정보, 지침, 도움, 오락, 심지어 위안까지 가져다줄 수 있다. 하지만 계몽(Enlightenment)을 가져다줄 수는 없다. 사실, AI는 우리를 계몽으로부터 그 어느 때보다 더 멀어지게 할지도 모른다.”

- 오픈AI가 노르웨이에 엔스케일 홀딩스, 에이커(Aker)와 협력해 노르웨이 크반달(Kvandal)에 GPU 10만장 규모의 데이터센터를 내년 말까지 구축한다 (WSJ, 7월 31일). ‘스타게이트 노르웨이’라고 명명하게 되는 이 데이터센터는 풍부한 수력 발전과 낮은 전력 수요로 인해 에너지 가격이 유럽 평균보다 훨씬 낮은 노르웨이 북부를 시설 부지로 선정했으며, 전적으로 재생 에너지로 운영될 예정이다. 엔스케일과 에이커 합작법인이 부지를 소유하고 엔스케일이 설계하고 건설할 예정이며 초기 단계에 약 10억 달러를 투자한다. 스타게이트 UAE 이후 두 번째 스타게이트 글로벌 진출이며, 오픈AI가 미국에 만들려는 스타게이트가 일정이 늦어지고 있다는 얘기가 나오는 상황에서 나온 소식이라 결과가 어찌 될 지 지켜봐야 한다.

- 앤스로픽의 다리오 아모데이 격정 인터뷰(빅 테크놀로지 팟캐스트, 7월 31일). 유튜브에 올라온 아모데이 인터뷰가 흥미롭다. 펀딩을 앞두고 여러 CEO가 인터뷰 등을 하면서 자신이 추구하는 사업 전략과 방향을 얘기하는 것은 자주 있는 일인데, 이번 인터뷰는 그의 솔직함과 직설적 화법이 드러나는 인터뷰였다. 인터뷰는 빅 테크놀로지 팟 캐스트를 운영하는 알렉스 칸트로위츠가 했다(참고: The Making Of Dario Amodei – by Alex Kantrowitz. 다리오 아모데이가 가진 생각에 대한 보다 상세한 정보).

- AGI는 실체가 아니다, 모호하고 정의되지 않았으며 대부분 실제 진전을 방해한다. “AGI”나 “ASI”는 이정표가 아니라 마케팅에 불과하다(나하고는 다른 입장이다).

- 앤스로픽은 올해 30억 달러의 손실을 볼 것이지만 걱정하지 않는다. 일단 모델이 학습되면 수익이 생기는데, 2023년에 1억 달러 모델이 2024년에는 2억 달러의 수익을 만들어 낼 수 있다. 손실이 아니라 투자이다.

- 모두가 오픈소스에 집착하는데 사용자들은 개방성에 관심이 있는 것이 아니라 결과에 관심 있다. 클로드가 더 작업을 잘 수행하면 사람들은 클로드를 쓸 것이다.

- 직원들이 저커버그로부터 거액의 제안을 받는 것을 알고 있다. 앤스로픽은 그런 게임을 하지 않을 것이고 협상도 없고 입찰 전쟁도 없을 것이다. 앤스로픽은 능력에 따라 직급을 배정 받기 때문이다.

- 오픈AI와 경쟁하기 위해 1,000억 달러가 필요하지 않다. 남들이 1,000억 달러로 하는 일을 우리는 200억 달러로 더 빠르고 더 잘 해낼 것이기 때문이다.

- 앤스로픽은 소비자를 쫓는 것이 아니라 비즈니스에 베팅하고 있다. 기업이 사용하기에 가장 적합한 API를 구축하고 있고 조용히 비즈니스에서 AI의 중추가 되고 있다.

- AI 확장은 쉬우나 얼라인먼트는 어렵다. AI가 인간을 돕고 싶게 하는 것이 진정한 과제이다. 그것이 클로드를 만든 이유이고 오픈AI를 떠나서 자신의 방식대로 한 이유이다.

- 나는 파멸론자가 아니다! 내 아버지는 몇 년 전에 가능했을 치료법 때문에 돌아가셨다. 나는 이 기술의 이점을 이해한다.

- WSJ가 중국의 국내 AI 생태계 구축 노력에 대한 기사를 실었다. 새로운 산업 연합인 ‘모델-칩 생태계 혁신 연합’과 ‘상하이 상공회의소 AI위원회’가 출범했다.

- NIST는 AI 테스트, 평가, 검증 및 검증 ” 초안 “에 대한 “방향과 구조를 제안하는” 개요를 발표했다. 9월 12일까지 이에 대한 의견을 접수한다.

- 유럽 위원회는 EU의 “AI 기가팩토리”를 위해 400억 유로 상당의 미국 AI 칩을 구매하겠다고 약속했다.

- 영국은 1,500만 파운드 규모의 AI 얼라인먼트 프로젝트를 가동했다.

- CSIS 퓨처스 랩의 보고서는 알렉시스 드 토크빌의 ‘미국의 민주주의’에서 영감을 받아 AI 벤치마킹이 민주주의 사회에서 AI 시스템의 책임성과 투명성을 보장하는 데 필수적인 새로운 형태의 시민 연합이 될 수 있다고 주장했다.