2021. 4월 21일. 유럽 집행위원회는 유럽의회에 인공지능법안을 발의했습니다. EU 인공지능법(AI Act)은 ‘고위험’ 인공지능의 개발과 사용을 규제하고, 인공지능시스템의 영향을 받는 사람들의 권리를 보호하면서 ‘ 신뢰할 수 있는 인공지능’의 활용을 촉진하는 것을 목표로 합니다.

이주의 맥락에서 국경 통제를 위한 생체인식 식별시스템, 국경 모니터링, 예측 분석 시스템 등의 무차별적인 감시를 위해 인공지능 시스템의 사용은 증가하고 있습니다. 인종, 민족, 피부색이 개인의 이주 상태를 결정하는 심각한 위험이 존재합니다.

그러나 인공지능법(안)은 이주와 국경 통제에 ‘고위험’ 인공지능 시스템의 사용을 열거하고 있지만, 사람들의 권리에 영향을 미치고 감독 및 투명성 조치를 받아야하는 모든 인공지능 기반 시스템을 포착하지 못합니다. 제대로 위험을 방지하지 못하고 있습니다.

이에, 지난 12월 6일, 194개 단체 및 개인은 유럽연합에 인공지능법이 이주민을 포함하여 모든 사람의 권리를 보호할 수 있도록 요구사항과 함께 개정을 촉구하는 공개 서한을 제출했습니다.

‘공개 서한’에서는 EU 인공지능법은 이주 환경에서 인공지능과 관련된 피해를 해결하기 위해 크게 네 가지를 개정할 것을 촉구하고 있습니다.

- 첫째, 이주 환경에서 인공지능 시스템의 ‘수용할 수 없는 사용을 금지(금지되는 위험)’

- 둘째, 이주에 사용되는 ‘고위험 시스템 목록 확장’

- 셋째, 이주의 ‘모든 고위험 시스템에 인공지능법이 적용되도록 보장’

- 넷째, 투명성 및 감독 조치가 적용되도록 보장할 것을 촉구하고 있습니다.

고위험 인공지능시스템의 수행주기뿐만 아니라 시스템을 배치하기 전에 기본권 영향평가를 실시하고 공개해야 하는 고위험 인공지능시스템 사용자에 대한 의무를 포함하도록 촉구하고 있습니다. (진보넷 mana2022)

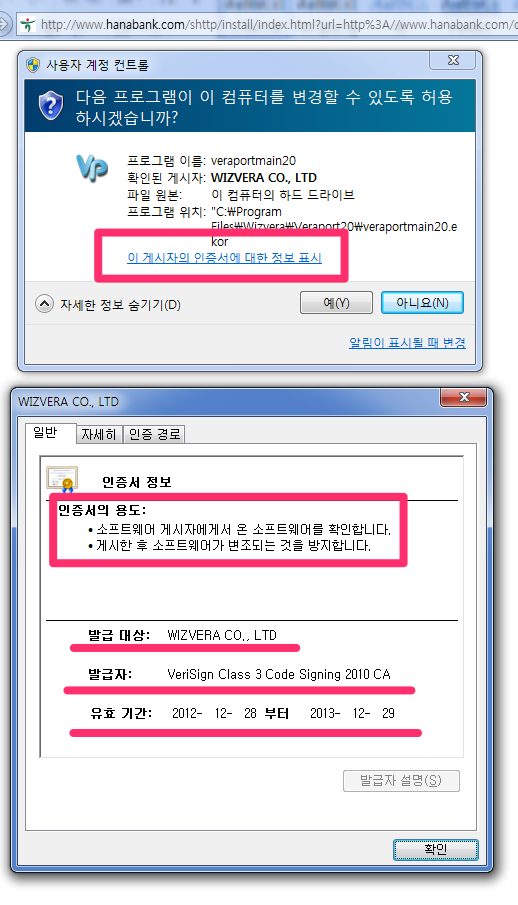

[divide style=”2″]

- 번역 오류는 policy 골뱅이 jinbo.net 으로 알려주세요.

- 제목: EU 인공지능법은 이동하는 사람들을 보호해야 합니다

- 원문 제목: Joint statement: The EU AI Act must protect people on the move

- 원문 링크: https://www.accessnow.org/joint-statement-ai-act-people-on-the-move

- 일시: 2022년 12월 6일

- 초안 제목: Access Now, European Digital Rights (EDRi), Platform for International Cooperation on Undocumented Migrants, and the Refugee Law Lab.

[divide style=”2″]

EU 인공지능법은 이동하는 사람들을 보호해야 합니다

(번역: 진보넷, mana2022)

유럽연합(EU) 인공지능법(AI Act)은 ‘고위험’ 인공지능의 개발과 사용을 규제하고, 인공지능시스템의 영향을 받는 사람들의 권리를 보호하면서 ‘신뢰할 수 있는 인공지능 ‘의 활용을 촉진하는 것을 목표로 합니다.

그러나 EU 인공지능(AI)법은 원안에서 인공지능을 이주 맥락에서 사용함으로써 발생하는 피해를 적절하게 처리하거나 방지하지 않습니다. 국가와 기관은 종종 사회 전반에 걸쳐 소외계층과 이동 중인 사람들(즉 이주민, 망명 신청자 및 난민)을 위한 이익 차원에서 인공지능을 권장하지만, 인공지능 기술은 과잉감시, 범죄화, 구조적 차별, 폭력의 광범위한 시스템에 적합합니다.

EU 인공지능법은 이주 상태와 무관하게 모든 사람을 인공지능시스템의 유해한 사용으로부터 보호하는 것이 중요합니다. 아래 서명한 단체와 개인은 유럽의회, 유럽 집행위원회, 유럽연합 이사회, 유럽연합 회원국에 유럽연합(이하, EU) 인공지능법이 이주민을 포함하여 모든 사람의 권리를 보호할 것을 촉구합니다. 인공지능법에 대한 다음과 같은 개정을 촉구합니다.

1. 이주 환경에서 인공지능 시스템의 수용할 수 없는 사용을 금지합니다

일부 인공지능시스템은 우리의 기본권에 ‘수용할 수 없는 위험(금지되는 위험)’을 초래하며, 이는 기술적 수단이나 절차적 안전장치에 의해 절대 해결되지 않습니다. 제안된(원안) 인공지능 법은 인공지능의 일부 사용을 금지하지만, 돌이킬 수 없는 피해의 가능성에도 불구하고 이주와 국경 통제에서 인공지능의 가장 유해한 사용중 일부를 막지는 못합니다.

인공지능법(AI Act)은 다음의 사항을 ‘금지행위’로 포함하도록 개정해야 합니다.

- 이주를 차단, 축소 및 금지하는데 사용되는 예측분석시스템: 이러한 시스템은 “비정규 이주”의 위험이 어디에 있는지를 예측하고, 유럽 국경의 문지기(gatekeepers)로 등록된 제3국에 의해 종종 행해지는 이동을 금지하거나 멈추기 위한 예방적 대응을 촉진하기 위해 사용될 수 있습니다. 이러한 시스템은 사람들이 망명을 신청하는 것을 막고, 난민 송환의 위험에 노출되고, 자유로운 이동에 대한 권리를 침해하고, 사람들의 생명권, 자유 및 안전에 대한 권리를 위협하는 징벌적이고 폭력적인 국경통제 정책에 사용될 위험이 있습니다.

- 자동화된 위험평가 및 프로파일링 시스템: 이러한 시스템은 인공지능을 사용하여 이주민들이 위법 활동이나 보안 위협의 ‘위험’을 야기하는지 여부를 평가하는 것이 포함됩니다. 이러한 시스템은 본질적으로 차별적이며, 사람들이 통제할 수 없는 요인이나 개인적 특성에 기초한 차별적 추론에 근거하여 사람들을 사전에(미리) 판단합니다. 따라서 이러한 관행은 평등과 차별금지, 무죄 추정과 인간의 존엄성을 훼손합니다. 이것은 또한 노동권, (위법 구금을 통한)자유, 공정한 재판, 사회적 보호 또는 건강에 대한 부당한 침해를 초래할 수 있습니다.

- 감정 인식 및 생체인식 분류 시스: 인공지능 거짓말 탐지기와 같은 시스템은 생체인식 데이터를 기반으로 감정을 추론한다고 주장하는 사이비 과학 기술이며, 행동 분석은 외모를 기반으로 ‘의심스러운’ 개인을 감지하는데 사용됩니다. 이러한 사용은 이주민에 대한 인종차별적 의심을 강화하고 차별적 가정을 자동화할 수 있습니다.

- 국경 및 구금 시설 내부 및 주변의 원격생체인식(RBI): 원격생체인식(얼굴인식 사용 등)에 대한 금지는 기술이 억제 및 광범위한 차단체제의 일부로 국경지역을 감시하고 사람들이 망명을 요청하지 못하게 하고 국제법에 따른 회원국의 의무, 특히 강제송환금지 권리를 지지하는 것을 가로막는 디스토피아 시나리오를 방지하는데 필요합니다.

2. 이주에 사용되는 고위험 시스템 목록을 확장해야 합니다

제안서는 이미 부록 III에 이주와 국경 통제에 ‘고위험’ 인공지능 시스템의 사용을 열거하고 있지만, 사람들의 권리에 영향을 미치고 감독 및 투명성 조치를 받아야하는 모든 인공지능 기반 시스템을 포착하지 못합니다.

이주에 사용되는 모든 인공지능 시스템이 규제되도록 하려면 부록 III를 개정하여 다음을 ‘고위험’으로 포함해야 합니다.

- 생체인식 식별 시스템: 생체인식시스템(모바일 지문 스캐너 등)은, EU국경 및 EU국경내에서 신원 확인을 수행하는데 점점 더 많이 사용되고 있습니다. 이러한 시스템은 인종, 민족 또는 피부색이 개인의 이주 상태를 대신(결정)하는 역할을 하면서 인종 프로파일링의 불법적이고 유해한 관행을 촉진하고 증가시킵니다. 이러한 시스템의 사용에 따른 심각한 차별 위험 때문에, 입법자(의원)들은 EU 인공지능법이 이러한 사용을 규제하도록 보장해야 합니다.

- 국경 모니터링 및 감시를 위한 인공지능시스템: EU 영토로 가는 안전하고 규칙적인 경로가 없을 때, 사람들은 불규칙적인 수단을 통해 유럽 국경을 넘을 것입니다. 당국은 국경에서 드론이나 열화상 카메라와 같이, 일반적이고 무차별적인 감시를 위해 인공지능시스템을 점점 더 많이 사용하고 있습니다. 이러한 기술의 사용은 국경에서의 폭력을 악화시키고 집단 추방이나 불법적인 반발을 촉진할 수 있습니다. 고조되는 위험과 구조적 불평등의 확대를 고려할 때, 입법자(국회의원)들은 국경 감시에 사용되는 모든 인공지능시스템을 인공지능법의 적용 범위에 포함시켜야 합니다.

- 이주, 망명 및 국경통제에 사용되는 예측분석시스템: 이주 흐름에 대한 예측을 생성하기 위해 사용되는 시스템은 기본권과 국제 보호 절차에 대한 접근에 막대한 결과를 초래할 수 있습니다. 이러한 시스템은 이주 통제 및 국제 보호 맥락에서 자원을 평가하고 배분하는 방법에 영향을 미칩니다. 이주 동향과 수용 요구에 대한 잘못된 평가는 회원국의 준비뿐만 아니라 개인이 국제적 보호 및 기타 많은 기본권에 접근할 수 있는 가능성에도 중대한 결과를 초래할 것입니다. 따라서 이러한 예측시스템은 이주의 맥락에서 배치될 때 ‘고위험’으로 간주되어야 합니다.

3. EU IT시스템의 일부로서 사용되고 있는 시스템을 포함한 이주의 모든 고위험 시스템에 인공지능법이 적용되도록 해야 합니다

인공지능법 제83조는 법 시행 당시 이미 시장에 출시된 인공지능시스템에 대한 규칙을 규정하고 있습니다. 제83조에는 Eurodac(지문DB), Sengen Information System(솅겐정보시스템), ETIAS(유럽여행정보인증제도) 등 이주에 사용되는 EU의 대규모 IT 시스템의 일부를 구성하는 인공지능시스템의 부분을 포함합니다.

이러한 대규모 IT시스템은 모두 3억 개 이상의 기록 용량을 예상하고 있으며, 개인정보 및 민감정보의 자동 처리, 자동화된 위험평가시스템 또는 생체인식 식별을 위한 기술 사용이 포함됩니다. 예를 들어, EU는 향후 몇 년 내에 모든 비자 및 ‘여행 허가’ 신청자에게 자동화된 위험 프로파일링 기술을 적용할 계획입니다. 또한 EU 기관들은 현재 망명 신청자들의 데이터베이스에 얼굴 이미지 처리(얼굴 인식)를 포함시키기 위해 Eurodac 업데이트를 검토하고 있습니다.

이러한 데이터베이스를 배제하는것은, EU 인공지능법의 안전장치가 적용되지 않음을 의미합니다. 이 포괄적인 면제는 EU 이주 통제에 사용되는 인공지능시스템의 책임, 투명성 및 감독을 감소시키고 EU의 대규모 IT 시스템의 일부로서 인공지능 시스템의 영향을 받는 사람들에 대한 보호를 축소시키는데 일조할 것입니다. 이러한 시스템에 대한 규제 조사의 면제로 인해, EU 인공지능법은 개인의 이주 상태에 따라 개인의 기본권을 보호하는데 있어 이중 기준을 초래하게 됩니다.

EU 인공지능법은 제83조가 모든 고위험 시스템에 동일한 준수 규칙을 적용하고 이주 상태에 관계없이 모든 개인의 기본권을 보호하도록 개정해야 합니다.

4. 투명성 및 감독 조치가 적용되도록 보장해야 합니다

고위험 인공지능시스템의 영향을 받는 사람들은 그러한 시스템이 자신의 권리를 침해할 때 상황을 이해하고, 이의를 제기하고, 구제책을 찾을 수 있어야 합니다. 이주의 맥락에서, 이 요구사항은 인공지능시스템을 배치하는 사람들과 그 대상자들 사이의 압도적인 힘의 불균형을 고려할 때 시급하고 절실합니다.

EU 인공지능법은 이주와 국경통제에 사용되는 인공지능시스템의 피해를 방지하고, 공공의 투명성을 보장하며, 사람들이 정의를 추구할 수 있는 권한을 부여해야 합니다. EU 인공지능법은 다음과 같이 개정되어야 합니다.

- 고위험 인공지능시스템의 수행주기뿐만 아니라 시스템을 배치하기 전에 기본권 영향평가(FRIA)를 실시하고 공개해야 하는 고위험 인공지능 시스템 사용자에 대한 의무를 포함해야 합니다.

- 당국이 이주, 망명 및 국경 관리를 위한 고위험 및 모든 공공 인공지능의 사용을 EU 데이터베이스에 등록하도록 요구사항을 보장해야 합니다. 공공의 투명성은 효율적인 감독을 위해 필수적이며, 특히 다수의 기본권이 위태로운 이주의 고위험 영역에서 중요합니다. 인공지능법은 법집행과 이주의 투명성 조치에 대한 분리를 허용하지 않는 것이 중요합니다.

- 인공지능시스템이 자신의 권리를 침해했을 때 사람과 그룹이 이해하고, 설명을 요구하고, 이의를 제기하고, 구제를 받을 수 있도록 하는 권리와 구제 메커니즘을 포함해야 합니다. 인공지능법은 영향을 받는 사람들 또는 그들을 대신한 공익(시민)단체가 인공지능시스템이 규정을 준수하지 않거나 기본권을 침해하는 경우 해당 범위에 있는 인공지능시스템에 문제를 제기할 수 있는 효과적인 수단을 제공해야 합니다.